Während der Softwareumfang im Fahrzeug stark zunimmt, orientieren sich die Teststrategien in vielen Unternehmen weiterhin an traditionellen, hardwarezentrierten Vorgehensweisen. Steffen Schmidt, President & CEO von IPG Automotive, sieht diesen Ansatz allein als nicht mehr zukunftsfähig. Im Interview mit AEEmobility erläutert er, warum klassische Teststrategien an ihre Grenzen stoßen und weshalb Simulation und Software-in-the-Loop künftig das Rückgrat der funktionalen Absicherung bilden müssen.

Herr Schmidt, die Transformation hin zum Software-defined Vehicle stellt die Branche vor erhebliche Herausforderungen. Neben dem stark wachsenden Softwareumfang wirkt sich vor allem die zunehmende Zentralisierung der Elektronikarchitekturen aus. Vor diesem Hintergrund stellt sich die Frage, wie diese Entwicklung die Teststrategie verändert.

Steffen Schmidt: Beim Übergang zum Software-defined Vehicle stehen wir aus meiner Sicht vor drei zentralen Herausforderungen. Zum einen wächst der Softwareumfang rasant. Moderne Fahrzeuge enthalten heute schon über 100 Millionen Zeilen Code, und für 2030 erwarten wir je nach Szenario 500 Millionen bis hin zu einer Milliarde Zeilen Code. Zum anderen verändert sich die Architektur grundlegend – zentrale Hochleistungsrechner und serviceorientierte Strukturen gewinnen an Bedeutung.

Der dritte Punkt betrifft die Rückrufkosten. Während 2011 nur etwa 5 bis 10 Prozent der Rückrufe auf Elektronik- oder Softwareprobleme zurückgingen, lag dieser Anteil 2022 bereits bei über 65 Prozent – und aktuelle Daten bewegen sich Richtung 80 Prozent. Je mehr Software im Fahrzeug steckt, desto stärker steigt zwangsläufig auch der Anteil softwarebedingter Fehler.

Bei den Teststrategien zeigt sich derzeit, dass ein Großteil der Validierung weiterhin im Feldversuch oder auf Prüfgeländen erfolgt. Das ist künftig nicht mehr tragfähig. Fehler werden häufig erst dann entdeckt, wenn schon viel Zeit und Aufwand investiert wurden – die notwendigen Schleifen zurück in die Entwicklung sind langwierig und teuer. Besonders schwierig ist, dass seltene, aber kritische Situationen im realen Fahrversuch zufällig auftreten und sich kaum reproduzieren lassen. Mit der steigenden Komplexität moderner Fahrzeugsysteme wird dieses Vorgehen immer ineffizienter. Am Ende führt die späte, hardwarezentrierte Validierung zu hohen Kosten, langen Entwicklungszeiten und einer begrenzten Testtiefe. Eine frühere, softwareorientierte Teststrategie kann viele dieser Probleme spürbar entschärfen. Erste Schritte sind gemacht, doch es wird noch einige Jahre dauern, bis Software-in-the-Loop-basierte Ansätze flächendeckend etabliert sind.

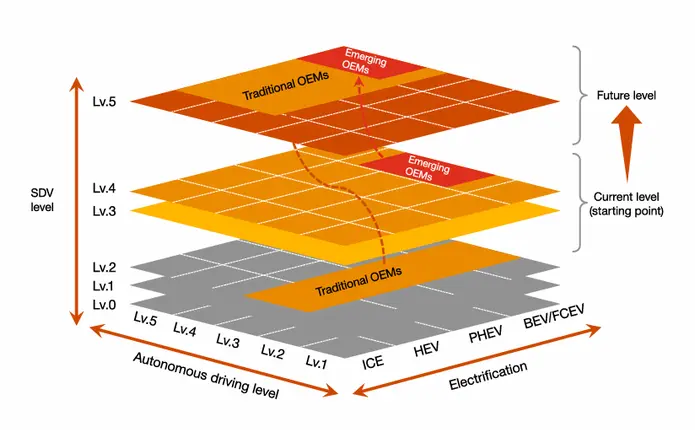

Die Transformation der Automobilindustrie hin zum softwaredefinierten Fahrzeug erfordert angepasste Teststrategien: Ziel sind kürzere Entwicklungszyklen, geringere Entwicklungs- und Gewährleistungskosten sowie eine höhere Softwarequalität und funktionale Sicherheit über den gesamten Entwicklungsprozess. (Bild: IPG Automotive)

Werden solche simulationsbasierten Verfahren bereits vom Kraftfahrt-Bundesamt anerkannt, oder ist weiterhin eine vollständige Absicherung durch reale Erprobungen mit Millionen oder gar Milliarden von Fahrkilometern erforderlich?

Sowohl die OEMs und Zulieferer als auch Tool-Anbieter und homologierende Behörden sind gefordert, entsprechende Grundlagen zu schaffen. Erste Schritte sind bereits im Rahmen von Euro NCAP erkennbar. Dort ist vorgesehen, dass künftig nicht mehr sämtliche Tests vollständig auf dem Prüfgelände durchgeführt werden, sondern ein deutlich größerer Anteil simulationsbasiert erfolgt. Dieser Ansatz zeigt einen klaren Trend in die richtige Richtung und unterstützt auch die notwendige Abstimmung zwischen Industrie und Regulierung. Eine belastbare zeitliche Einschätzung, wann sich dieses Vorgehen vollständig etabliert, ist aktuell jedoch kaum möglich.

Derzeit steht vor allem die Sensorik im Mittelpunkt: Kundenanfragen richten sich gezielt auf die Genauigkeit der Sensormodelle und deren Realitätsnähe. Es werden daher Validierungsnachweise für unterschiedliche Sensortechnologien erbracht, in der Regel gemeinsam mit den jeweiligen Sensorherstellern. Ziel ist es, nachzuweisen, dass virtuelle Sensoren das reale Verhalten innerhalb definierter Toleranzen zuverlässig abbilden.

Wie müssen Industrie und Genehmigungsbehörden ihre Freigabeprozesse weiterentwickeln, um neue Technologien schneller in die Serie zu überführen – und droht andernfalls ein Wettbewerbsnachteil gegenüber China?

Die Ursachen für den langsamen Fortschritt liegen weniger in regionalen Unterschieden als in den bestehenden strukturellen Rahmenbedingungen. Zentral ist dabei, die zuständigen Genehmigungsbehörden frühzeitig und deutlich stärker einzubinden sowie Vertrauen in die neuen Technologien aufzubauen. Validierungsprojekte spielen hierbei eine Schlüsselrolle, da sie die Leistungsfähigkeit und Zuverlässigkeit neuer Ansätze nachvollziehbar belegen und somit die regulatorische Absicherung ermöglichen.

Parallel dazu zeigt sich, dass die Entwicklungsdynamik in der europäischen – teils auch nordamerikanischen – Automobilindustrie vergleichsweise gering ist. In anderen Märkten lassen sich neue Technologien häufig schneller umsetzen, da sie ohne historische Strukturen, mit weniger organisatorischen Silos und geringerer Bürokratie entwickelt werden. Das führt zu kürzeren Entscheidungswegen und einer stärkeren Fokussierung auf Entwicklungsgeschwindigkeit.

Zeit und Rechenaufwand sind zentrale Faktoren beim szenariobasierten Testen. CarMaker ermöglicht zwar Millionen von Simulationen, aber wie stellen Sie sicher, dass solche Testumfänge auch wirtschaftlich skalierbar sind? Welche Rolle spielen dabei softwarebasierte Teststrategien im Vergleich zu klassischen, hardwarelastigen Ansätzen?

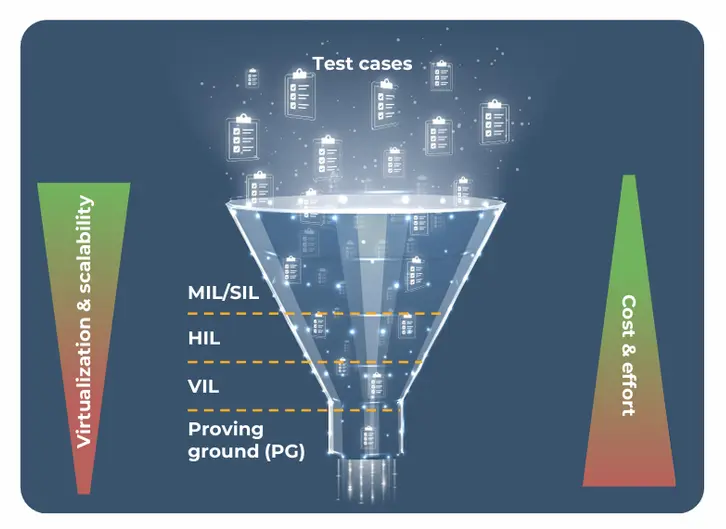

Die Wirtschaftlichkeit hängt maßgeblich von der gewählten Teststrategie ab. Klassische, stark hardwaregetriebene Ansätze sind teuer, zeitaufwendig und nur begrenzt skalierbar. Tests auf dem Prüfstand oder auf dem Testgelände lassen sich kaum parallelisieren und stoßen angesichts der heutigen Funktionsvielfalt schnell an ihre Grenzen.

Steffen Schmidt, President & CEO von IPG Automotive: „Besonders schwierig ist, dass seltene, aber kritische Situationen im realen Fahrversuch zufällig auftreten und sich kaum reproduzieren lassen. Mit der steigenden Komplexität moderner Fahrzeugsysteme wird dieses Vorgehen immer ineffizienter. Am Ende führt die späte, hardwarezentrierte Validierung zu hohen Kosten, langen Entwicklungszeiten und einer begrenzten Testtiefe.“ (Bild: IPG Automotive)

Softwarebasierte Teststrategien bieten hier einen klaren Vorteil. Wird CarMaker in einer Cloud-Umgebung mit virtuellen ECUs eingesetzt, lassen sich Tests nahezu beliebig parallel ausführen. Innerhalb weniger Tage oder Wochen wird eine Testtiefe erreicht, für die früher Monate nötig waren. Kunden erreichen so bereits heute Größenordnungen von bis zu einer Million simulierten Tests pro Woche. Die heutigen kurzen Entwicklungs- und Updatezyklen lassen sich nur mit stark parallelisierten, virtuellen Tests absichern. Weder Labore noch Testgelände können den dafür notwendigen Umfang abdecken.

„Seltene, sicherheitskritische Situationen lassen sich im realen Fahrversuch kaum reproduzieren, virtuell dagegen gezielt, wiederholbar und in großer Tiefe.“

Steffen Schmidt, CEO von IPG Automotive

Eine Cloud – wahlweise unternehmensintern oder öffentlich, wie AWS oder Azure – ist aus wirtschaftlicher Sicht klar im Vorteil. Die Skalierbarkeit ist dabei der entscheidende Faktor: Müssen eine Million Tests in fünf statt in sieben Tagen durchgeführt werden, lässt sich kurzfristig zusätzliche Rechenkapazität hinzubuchen.

Durch die vollständige Einbettung der Tests in CI-, CT- und CD-Pipelines ergeben sich erhebliche Geschwindigkeitsvorteile. Kontinuierliche Entwicklung, kontinuierliches Testen, weitgehende Automatisierung sowie automatisierte Auswertung der Testergebnisse ermöglichen Durchlaufzeiten, die mit klassischen, statischen Testansätzen heute nicht mehr erreichbar sind.

Softwarezentrierte End-to-End-Teststrategie für softwaredefinierte Fahrzeuge: Tests werden stärker in frühe Entwicklungsphasen verlagert (Front-Loading), um Reifegrade früher zu erreichen, Fehler schneller zu erkennen und deren Behebung effizienter zu gestalten. Gleichzeitig ermöglicht die Virtualisierung eine höhere Skalierbarkeit und Testabdeckung über den gesamten Entwicklungsprozess hinweg. (Bild: IPG Automotive)

Wo stößt die Simulation heute noch an ihre Grenzen, und wie werden solche Einschränkungen in der Praxis adressiert?

Aus unserer Sicht lässt sich ein sehr großer Teil dessen, was in der realen Welt getestet wird, virtuell abbilden. Unterschiedliche Fahrstile, Verkehrssituationen und viele komplexe Phänomene können simuliert – und das ist ein entscheidender Vorteil – jederzeit reproduziert werden. Ein Szenario, das in der Realität nur zufällig auftritt, lässt sich virtuell beliebig oft unter exakt gleichen Bedingungen wiederholen. Trotzdem ist das keine Entweder-oder-Frage. Die Simulation kann reale Tests nicht vollständig ersetzen, denn neue oder bislang unbekannte Phänomene entstehen immer zuerst in der realen Welt. Nur was man kennt oder beobachtet hat, lässt sich auch modellieren. Reale Erprobung und Felddaten bleiben deshalb unverzichtbar. Der Mehrwert entsteht im Zusammenspiel beider Welten – Simulation bestimmt zunehmend, welche realen Tests Priorität haben. Sobald ein relevantes Ereignis in der Realität identifiziert ist, lässt es sich in der Simulation effizient nachbilden und absichern. Statt Millionen weiterer realer Kilometer zu fahren, um ein seltenes Szenario noch einmal herbeizuführen, kann man es virtuell gezielt und wirtschaftlich testen.

Welche Rolle wird das Testgelände dann künftig noch spielen?

In virtuellen Umgebungen und Vehicle-in-the-Loop-Setups arbeiten Sensoren stets mit synthetischen Umfeldern. Die modellhafte Abbildung der vollständigen physischen Wirkkette ermöglicht eine effiziente Entwicklung und Absicherung von Funktionen. Testgelände werden also auch künftig weiterhin eine wichtige Rolle spielen, allerdings in einer deutlich veränderten Funktion. Sie dienen nicht mehr dazu, möglichst viele Kilometer zu sammeln, sondern vielmehr der gezielten Absicherung zentraler Funktionen unter realen physikalischen Bedingungen. Am Ende des Entwicklungsprozesses bleibt es aber unverzichtbar, das Fahrzeug als Gesamtsystem in seiner finalen Hardware-Konfiguration real zu erleben und zu erproben.

„Die Absicherung hochkomplexer Fahrzeugsysteme kann nur noch statistisch erfolgen. Weder eine Million noch hundert Millionen gefahrene Testkilometer garantieren Sicherheit.“

Steffen Schmidt, CEO von IPG Automotive

Der Fokus verschiebt sich also klar von der Quantität der gefahrenen Kilometer hin zur Qualität und Vielfalt der Testfälle. Eine Million Kilometer unter gleichförmigen Bedingungen liefern kaum Erkenntnisse, wenn kritische Szenarien fehlen. Genau hier liegt der Mehrwert moderner Simulations- und Softwarelösungen: Sie ermöglichen eine durchgängige Nachvollziehbarkeit, von der Definition eines Use Cases über dessen virtuelle und reale Absicherung bis hin zum dokumentierten Testergebnis. Testgelände werden also Teil eines hybriden Testkonzepts, das virtuelle und reale Erprobung sinnvoll kombiniert. Die eigentliche Herausforderung liegt darin, den Übergang vom heute stark realgetriebenen Ansatz hin zu diesem integrierten Zielbild konsequent zu gestalten.

Was müsste sich in den Unternehmen ändern, um diesen Wandel zu beschleunigen?

Die zentrale Frage lautet, wie der Übergang vom Ist-Zustand zum angestrebten Ziel gelingt. Entscheidend dafür ist, wie viel Zeit Unternehmen für Entwicklung und Normierung benötigen und wie stark eine softwarezentrierte Denkweise bereits verankert ist. In vielen Organisationen dominiert nach wie vor ein hardwarezentrierter Ansatz. Damit stellen sich drei wesentliche Fragen: Wie kommt man überhaupt dorthin? Wie lange dauert es? Und wie groß ist die Bereitschaft, den Prozess zu beschleunigen? Denn ein höheres Tempo bedeutet zwangsläufig tiefgreifende Veränderungen in Prozessen, Strukturen und vor allem im Mindset. Genau darin liegt aus meiner Sicht die eigentliche Herausforderung. Die Technologie selbst ist dabei weniger das Problem. Sie ist bereits weit entwickelt, und Unternehmen können auf diesem Weg unterstützt werden.

Homologation, Sicherheitsnachweise und szenariobasierte Tests führen zu einem explosionsartigen Wachstum der benötigten Datenmengen. Wie stellen Sie sicher, dass Ihre Kunden nicht im Szenario- und Datenchaos versinken?

Die Frage ist absolut berechtigt. Mit dem zunehmenden Einsatz von Simulation, insbesondere im Vergleich zu realen Entwicklungs- und Testmethoden, lassen sich viele bewährte Prinzipien aus der klassischen Fahrzeugentwicklung übertragen. Genau aus diesen Anforderungen heraus ist VIRTO entstanden. Wenn wir verstärkt simulieren wollen, benötigen wir zunächst saubere Prozesse zum Aufbau virtueller Prototypen. Diese Prototypen basieren auf Daten, die in Unternehmen häufig verteilt vorliegen. Sobald diese virtuellen Fahrzeuge existieren und man in Richtung Testing geht, kommen die Szenarien hinzu – und zwar ebenfalls in sehr großen Stückzahlen.

VIRTO adressiert genau diese beiden Aspekte: Zum einen die Verwaltung virtueller Fahrzeugflotten, zum anderen das Management der Szenarien. Beides wird zusammengeführt und in einen durchgängigen Prozess eingebettet. Der entscheidende Vorteil ist, dass sämtliche Schritte vollständig nachvollziehbar sind. Anforderungen, Daten, Varianten und Testergebnisse lassen sich konsistent miteinander verknüpfen. In der Simulation haben wir eine eindeutige „Single Source of Truth“, was die Daten am Ende deutlich besser verwertbar macht.

ASAM OpenX – Standard-Ökosystem für simulationsbasierte Entwicklung und Test

ASAM OpenX bezeichnet eine Familie offener Standards, die von der Association for Standardisation of Automation and Measuring Systems (ASAM e.V.) entwickelt wurde und sich auf simulationsbasierte Entwicklung, Test und Validierung in der Automobilindustrie konzentriert. Ziel ist es, eine einheitliche, hersteller- und werkzeugübergreifende Beschreibung von Straßen, Szenarien, Umgebungen und Schnittstellen zu ermöglichen. OpenX-Standards bilden damit eine gemeinsame Sprache für virtuelle Testwelten und schaffen die Grundlage für reproduzierbare und interoperable Simulationen. Sie kommen insbesondere bei der Absicherung von Fahrerassistenz- und automatisierten Fahrfunktionen zum Einsatz, bei denen seltene und sicherheitskritische Szenarien systematisch geprüft werden müssen. In der Praxis nutzen Fahrzeugentwickler OpenX-Standards, um etwa Euro-NCAP-Szenarien für simulierte Testfahrten zu modellieren oder um Verkehrsnetze und Bewegungsabläufe in Simulationsumgebungen zu standardisieren. Mit wachsender Software- und Systemkomplexität gewinnen OpenX-Standards an Bedeutung, da sie den Austausch von Szenarien und Modellen zwischen unterschiedlichen Tools erleichtern und durchgängige, skalierbare Testprozesse unterstützen.

Sind Ihre Werkzeuge ausschließlich für die späten Absicherungsphasen gedacht oder lassen sie sich auch bereits in frühen Konzept- und Architekturphasen der Entwicklung einsetzen?

Unsere Werkzeuge werden bereits in frühen Entwicklungsphasen eingesetzt. Im Powertrain-Bereich beginnt das etwa bei grundlegenden Konzeptfragen wie der angestrebten Reichweite und der daraus resultierenden Batteriegröße. Auch bei sportlich ausgelegten, elektrischen Fahrzeugen lassen sich frühzeitig Fragen zur Batterieplatzierung untersuchen und deren Einfluss auf Fahrverhalten oder Rundenzeiten analysieren. Im Bereich Fahrerassistenz geht es in der Konzeptphase häufig um die optimale Sensorpositionierung, um in allen relevanten Fahrsituationen eine zuverlässige Umfeldwahrnehmung sicherzustellen. Für solche Fragestellungen existieren konkrete Kundenprojekte und Referenzen, in denen unsere Tools bereits sehr früh in der Planung eingesetzt wurden. Damit zeigt sich, dass sie nicht nur in der finalen Absicherung ihre Stärken ausspielen, sondern einen wichtigen Beitrag zur fundierten Auslegung von Fahrzeugkonzepten leisten.

Sie arbeiten eng mit dem Unternehmen Synopsys zusammen. Wie ist diese Kooperation entstanden, und welchen Mehrwert bietet sie Ihren Kunden?

Grundsätzlich ist die technologische Komplexität in der Fahrzeugentwicklung heute so hoch, dass kein einzelnes Unternehmen alle Fragestellungen allein optimal abdecken kann. Deshalb setzen wir bewusst auf ein starkes Ökosystem. Durch die offene Softwarearchitektur von CarMaker fällt es uns vergleichsweise leicht, technisch eng mit Partnern zusammenzuarbeiten und gemeinsam leistungsfähige Lösungen zu entwickeln. Die Zusammenarbeit mit Synopsys ist dafür ein gutes Beispiel. Synopsys bringt mit der Virtual-ECU – also einem virtuellen Steuergerät – eine Technologie ein, die sich optimal mit unseren Produkten ergänzt. Gleichzeitig gewinnt Software-in-the-Loop in der Entwicklung immer stärker an Bedeutung. Indem wir unsere Simulationskompetenz mit den Virtual-ECU-Lösungen von Synopsys kombinieren, lassen sich digitale Zwillinge aufbauen, die sowohl das Fahrzeug als solches, das Fahrzeugumfeld als auch die Steuergerätesoftware realitätsnah abbilden. Für die Kunden entsteht daraus eine durchgängige, hochwertige Gesamtlösung, bei der zwei jeweils führende Technologien miteinander verbunden werden. Ziel ist es, einen möglichst vollständigen und belastbaren digitalen Zwilling zu schaffen, der Entwicklung und Absicherung deutlich effizienter macht.

In welchem Umfang sind die ASAM-OpenX-Standards bereits in Ihre Werkzeuge integriert?

Im Kontext offener Standards spielt für uns die ASAM-OpenX-Familie (siehe Kastentext) eine zentrale Rolle. Dazu gehören OpenDRIVE, OpenSCENARIO und Open Simulation Interface, die bereits seit längerer Zeit etabliert sind, sowie seit Neuestem auch OpenMATERIAL. OpenDRIVE ist bereits seit Jahren ein etablierter und stabiler Standard. Auch OpenSCENARIO hat einen hohen Reifegrad erreicht, allerdings existieren im Markt noch unterschiedliche „Dialekte“, die eine durchgängige Nutzung teilweise erschweren. Grundsätzlich halten wir die Etablierung offener Standards für fachlich notwendig, um die Interoperabilität zwischen unterschiedlichen Werkzeugen und Entwicklungsumgebungen sicherzustellen. Entsprechend werden diese Standards zunehmend unterstützt und schrittweise tiefer in unsere bestehenden Toolchains integriert. Konkret ist vorgesehen, dass die nächste Generation von CarMaker, die dieses Jahr auf den Markt kommt, durch nativen Support der Standards nochmals einen großen Fortschritt bei der Unterstützung von OpenSCENARIO und OpenDRIVE bieten wird. (oe)

Vielen Dank für das Gespräch!

(Das Interview führte Klaus Oertel, Chefredakteur der AEEmobility)