NVIDIA hat eine umfassende Erweiterung seiner offenen Entwicklungsplattform Alpamayo für reasoning-basierte autonome Fahrzeuge (AV) angekündigt. Die Plattform wurde erstmals auf der CES 2026 vorgestellt und richtet sich an Entwickler und Forschende, die moderne, auf Schlussfolgerungen basierende AV-Systeme in realitätsnahen Closed-Loop-Umgebungen trainieren und evaluieren wollen. Nach Angaben von NVIDIA haben mehr als 100.000 Entwickler und Wissenschaftler das Alpamayo-1-Modell bereits heruntergeladen. Auf Basis von Feedbacks führt NVIDIA nun mehrere Neuerungen in den Bereichen Modelle, Datensätze und Simulation ein.

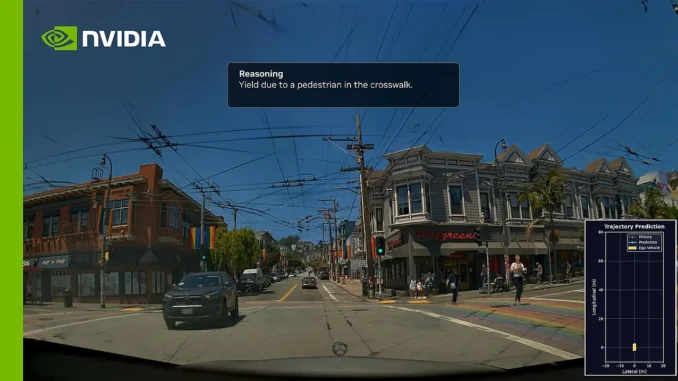

Kern der Erweiterung ist Alpamayo 1.5, ein weiterentwickeltes, offenes VLA-Modell mit 10 Milliarden Parametern. Es basiert auf der Cosmos-Reason2-Architektur, wurde mittels Reinforcement Learning nachtrainiert und unterstützt unter anderem textbasierte Trajektorienplanung, flexible Multi-Kamera-Setups sowie konfigurierbare Sensorparameter. Zudem ermöglicht das Modell die Beantwortung szenenbezogener Nutzeranfragen. Zu den zentralen Verbesserungen zählen eine präzisere Trajektoriengenerierung, höhere Qualität im Schlussfolgern sowie eine bessere Abstimmung zwischen Planung und Interpretation. Ergänzend stellt NVIDIA sofort einsetzbare Skripte für Supervised Fine-Tuning und RL-basiertes Post-Training bereit, die eine schnelle Anpassung an spezifische Anwendungsfälle ermöglichen.

Typische Einsatzszenarien reichen von Modell-Destillation über Datenannotation und -kuratierung bis hin zur Evaluierung von Edge-Modellen und visueller Szenenanalyse. Entwickler können Alpamayo 1.5 zudem zur Generierung alternativer Fahrentscheidungen auf Basis variierender Navigationsvorgaben nutzen. Parallel dazu erweitert NVIDIA den PhysicalAI-Autonomous-Vehicles-Datensatz um sogenannte Reasoning-Labels. Ergänzt wird dies durch eine automatisierte Chain-of-Causation-Labeling-Pipeline sowie ein Developer-Kit, das den Einstieg in die Arbeit mit den umfangreichen Multi-Sensor-Daten erleichtert. (oe)